黄仁勋即中本聪

过去因为相信所以看见的那个 token,现在不用相信就能看见。它是瓦特、安培、比特之后的下一个。

2009年1月,一个匿名者发明了一种叫 “token”的东西,你投入算力,获得 token,token在一个共识网络里流通、定价、交易。整个加密经济由此而生。十几年过去了,人们还在争论这种 token 到底有没有价值。

2025年3月,一个穿皮衣的男人重新定义了另一种叫 token 的东西。你投入算力,产出 token,token在一个 AI 推理(inference & reasoning )过程中里被立刻消费掉:思考、推理、写代码、做决策。整个 AI 经济由此加速。没有人争论这种 token 有没有价值,因为你今天早上刚用掉了几百万个。

两种 token,同一个名字,同一个底层结构:算力进去,有价值的东西出来。

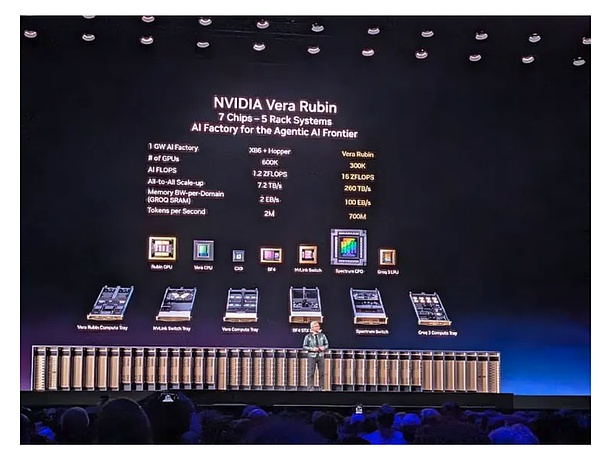

2026年3月,我坐在 NVIDIA GTC 会场里,听了黄仁勋一场几乎没有带货的主题演讲。是的,他发布了 Vera Rubin,一款 CPU 与 GPU 结合的产品。但这次,他没有讲芯片参数,没有讲制程工艺,他讲的是一套关于 token 生产、定价和消费的完整经济学——

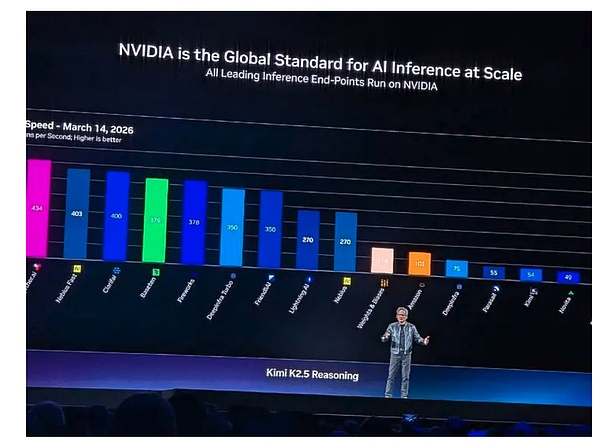

哪种模型,对应哪种 token 速度;哪种 token速度,对应哪个定价区间;哪个定价区间,需要什么级别的硬件来支撑。

他甚至帮台下的 CEO 和掌握着企业支票本的决策者们做好了数据中心的算力分配方案:25%给免费层,25%给中端,25%给高端,25%给高溢价层。

是的,这次他没有具体卖哪款 GPU 组,就像两年前卖 Blackwell 那样。但这次,他在卖一些更大的东西。两个小时下来,我觉得他最想讲的一句话其实是:Welcome to consume tokens, and only Nvidia's factory could produce。

这一刻我意识到,这个男人,和17年前那个匿名者挖出了第一个 token 的人,做的是结构上完全相同的一件事。

同一套转化规则

化名为“中本聪”的那个匿名者,在2008年写了一篇九页的白皮书,设计了一套规则:投入算力,完成一个数学证明(Proof of Work),获得 crypto token 作为奖励。

这个规则的精妙之处在于,他不需要任何人信任任何人——只要你接受这套规则,你就自动成为这个经济体的参与者。这个规则是对的,毕竟它让那么多尔虞我诈的人走到了一起。

而黄仁勋在 GTC 2026的舞台上,做了一件结构上一模一样的事。

他展示了一张图,彰显推理效率与 token 消耗的关系和张力:Y 轴是吞吐量(每兆瓦功耗产出多少 token),X 轴是交互性(每个用户感知到的 token 速度)。然后,他在 X 轴下面标了五个定价档:Free 用Qwen 3,$0/百万token;Medium 用 Kimi K2.5,$3/百万token;High 用 GPT MoE,$6/百万 token;Premium 用 GPT MoE 400K context,$45/百万 token;而 Ultra,$150/百万token。

这张图几乎可以当作黄仁勋 “token 经济学” 的白皮书封面。

中本聪定义了“什么是有价值的计算”——完成 SHA-256 哈希碰撞就是有价值的。而黄仁勋定义了“什么是有价值的推理”——在给定功耗约束下,以特定速度为特定场景产出 token就是有价值的。

中本聪和黄仁勋都没有直接生产 token,他们定义的都是 token 的生产规则和定价机制。

老黄在台上说的一句话,几乎可以直接写进 token 经济学白皮书的摘要——

Tokens are the new commodity, and like all commodities, once it reaches an inflection, once it becomes mature, it will segment into different parts.

Token是新的大宗商品。大宗商品成熟之后会自然分层。他不是在描述现状,他是在预判一个市场结构,然后把自己的硬件产品线,精确地铺在这个结构的每一层上。

两种 token的生产过程,甚至有一个语义上的对称:挖矿叫 mining,推理叫 inference。

挖矿和推理的本质,都是把电变成钱。矿工花电费挖 crypto token,然后卖掉,推理模型和 AI Agents 花电费产生 AI token,然后按百万计价卖给开发者。中间环节不同,两头都一样:左边是电表,右边是收入。

稀缺性的两种写法

中本聪做过的最重要的设计决策,不是 Proof of Work,是2100万枚的比特币总量上限。他用代码制造了人工稀缺——不管有多少矿机涌入,比特币的总量永远不会超过2100万枚。这个稀缺性是整个加密经济的价值锚。

而黄仁勋,用物理定律制造了天然稀缺。他说——

"You still have to build a gigawatt data center. You still have to build a gigawatt factory, and that one gigawatt factory for 15 years amortized... is about $40 billion even when you put nothing on it. It's $40 billion. You better make for darn sure you put the best computer system on that thing so that you can have the best token cost."

一个1GW 的数据中心永远不会变成 2GW。这不是代码限制,这是物理定律。

土地、电力、散热——每一项都有物理上限。你花400美元亿建好的这个工厂,15年的生命周期里能产出多少 token,完全取决于你往里面放了什么计算架构。

中本聪的稀缺性可以被 fork。不喜欢2100万枚的上限,fork一条新链,改成2亿枚,叫它以太币或什么鬼玩意儿,随你便,顺便再发个白皮书。而人们确实这么做了,乐此不疲。

而老黄制造的稀缺性不能被fork。毕竟你不能 fork热力学第二定律,不能 fork一个城市的电网容量,不能 fork一块土地的物理面积。

但无论是中本聪还是黄仁勋,他们创造的稀缺性都导致了同一个结果:硬件军备竞赛。

挖矿的历史是:CPU→GPU→FPGA→ASIC。每一代专用硬件都让上一代变成废铁。而 AI 训练和推理的历史也正在重演:Hopper→Blackwell→Vera Rubin→Groq LPU。通用硬件起步,专用硬件定局。老黄今年 GTC 展示的 Groq LPU,那个收购了 Groq 之后发布的确定性数据流处理器。静态编译,编译器调度,没有动态调度,500MB片上SRAM——它架构哲学上就是推理领域的 ASIC。只做一件事,但做到极致。

有意思的是:GPU 在两波浪潮里都扮演了关键角色。

2013年前后,矿工们发现 GPU 比 CPU 更适合挖 crypto token,英伟达显卡被买断货。10年后,研究者们发现 GPU 是训练和推理 AI 模型的最佳工具,英伟达数据中心卡再次被买断货。GPU 作为一个处理器门类,先后服务了两代 token 经济。

而区别在于,第一次英伟达是被动受益,然后也就没然后了。而第二次,在 AI 算力消费的主战场从预训练切换到推理测的时候,英伟达很快抓住机会主动设计了整个游戏,成为 AI 游戏规则的写入者。

全世界最赚钱的铲子

淘金热里最赚钱的不是淘金者,是卖铲子的 Levi Strauss。挖矿潮里最赚钱的不是矿工,是卖矿机的比特大陆和吴忌寒。AI 预训练和推理浪里最赚钱的不是基座模型和 Agent,而是卖 GPU 的英伟达。

但讲真,比特大陆跟英伟达置于各自产业的角色,已不可同日语。

比特大陆只卖矿机,英伟达还曾是比特大陆的供应商。你买了矿机,挖什么币、去哪个矿池、以什么价格卖出,都跟比特大陆无关。它是一个纯硬件供应商,赚的是一次性的设备利润。

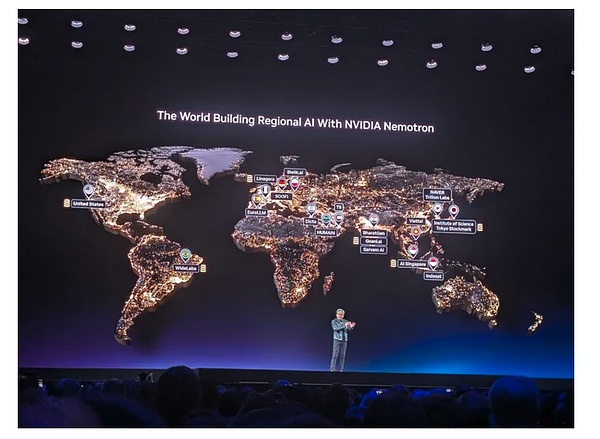

英伟达不一样。他不只卖硬件,现在,尤其是2025年推理侧 AI 爆发以来,它深度定义了应该用这款 GPU 挖什么 、如何给 token定价、token 卖给谁、数据中心应该怎么分配算力…… 这些都在老黄的演讲 PPT 里:他把市场分成五个 tier,每个 tier 对应什么模型、上下文长度、交互速度和价格……英伟达标准化、格式化了未来 AI 推理驱动一切的市场。

2018年前后,全球算力集中在几个大矿池——F2Pool、Antpool、BTC.com——它们互相竞争算力份额,但矿机来源高度集中在比特大陆。

一如今天的英伟达,60% 收入来自互相竞争的 “hyperscaler”,例如 AWS、Azure、GCP、Oracle、CoreWeave,而 40%来自分散的 AI Natives、主权AI 项目和企业客户。大“矿池”贡献主要营收,小“矿工”提供韧性和多元化。

两套生态的结构一模一样。但比特大陆后来遇到了竞争对手——神马矿机、芯动科技、嘉楠耘智都在蚕食它的份额。矿机是相对简单的 ASIC 设计,追赶者有机会。而撼动英伟达似乎变得越来越难:20年的 CUDA 生态,数亿 GPU 的安装基数,NVLink六代互联技术,Groq 整合后的解耦推理架构——英伟达的技术复杂性和生态壁垒,让大部分的竞争工具都无效了。

这可能得持续20年。

两种 token 的根本分叉

而让加密货币和 AI 训练和推理两种 token 产生本质不同的,是人们使用的动机和心理。

Crypto token 的需求侧是投机。没有人“需要”比特币来完成工作。所有宣称区块链代币能帮你解决问题的白皮书都是骗子些的。你持有 crypto,是因为相信未来会有人以更高的价格从你手里买走它。比特币的价值来自一个自我实现的预言:足够多的人相信它有价值,它就有价值。这是信仰经济。

而 AI token的需求侧是生产力。雀巢需要 token来做供应链决策——它的供应链数据从15分钟刷新一次变成3分钟刷新一次,成本降低83%,这个价值是可以直接映射到 P&L 上的。英伟达 100%的工程师已经需要 token 来写代码而不是手搓;研究团队需要 token 从事科研。你不需要相信 token有价值,你只需要用它,价值就在使用中自证了。

这是两种 token最本质的区别。Crypto token被生产出来是为了被持有和交易——它的价值在于不使用。AI token 被生产出来是为了被立刻消费掉——它的价值在于被用掉的那一刻。

一种是数字黄金,越囤越值钱;一种是数字电力,生产出来就烧掉。

这个区别决定了:AI token 经济不会像 crypto token 经济一样泡沫化。比特币大起大落,因为投机品的价格由情绪驱动。但token 的价格由使用量和生产成本驱动,只要 AI 持续有用——只要人们还在用 Claude Code 写代码、用 ChatGPT 写报告、用 Agent 跑业务流程,token 的需求就不会崩。它不靠信仰,靠的是离不开。

2008年,比特币白皮书需要反复一个去中心化的电子现金系统为什么有价值。17年过去了,人们还在争。

2026年,token 经济学没有引发任何争论,它甚至不需要论证就成了共识。老黄站在 GTC 的舞台上说“tokens are the new commodity”的时候,没有人质疑。因为台下坐着的每一个人,今天早上都用 Claude Code 或者 ChatGPT消费了几百万个 token。他们不需要被说服 token有价值——他们的信用卡账单已经证明了。

从这个意义上,老黄真的是中本聪的副本,那个替中本聪留下来垄断了矿机生产、定义了 token 的使用场景和使用规范、而且一年一度在圣何塞 SAP Center 举办一场 show,告诉人们下一代支持 AI 训练和推理的“矿机”有多强的那个副本。

中本聪有一种欲望审慎的魅力,他设计完规则,交给代码,然后消失。这是密码朋克的浪漫。而老黄比任何科学家都像生意人,他设计了规则,亲自维护,不断添砖加瓦,筑牢自己的护城河。

你过去因为相信所以看见的那个 token,现在不用相信就能看见。它是瓦特、安培、比特之后的下一个。

| 感动 | 同情 | 无聊 | 愤怒 | 搞笑 | 难过 | 高兴 | 路过 |

- 上一篇:很多人没看懂微策略:它真正的资产不是比…

- 下一篇:如何解构黄仁勋描绘的未来?

相关文章

-

没有相关内容

会员登录

会员登录